Small Language Models (SLM) statt LLM: Der Paradigmenwechsel in der KI für Unternehmen

Autor: Jean Hinz | KI Agentur Hamburg | Stand: Aug 2025

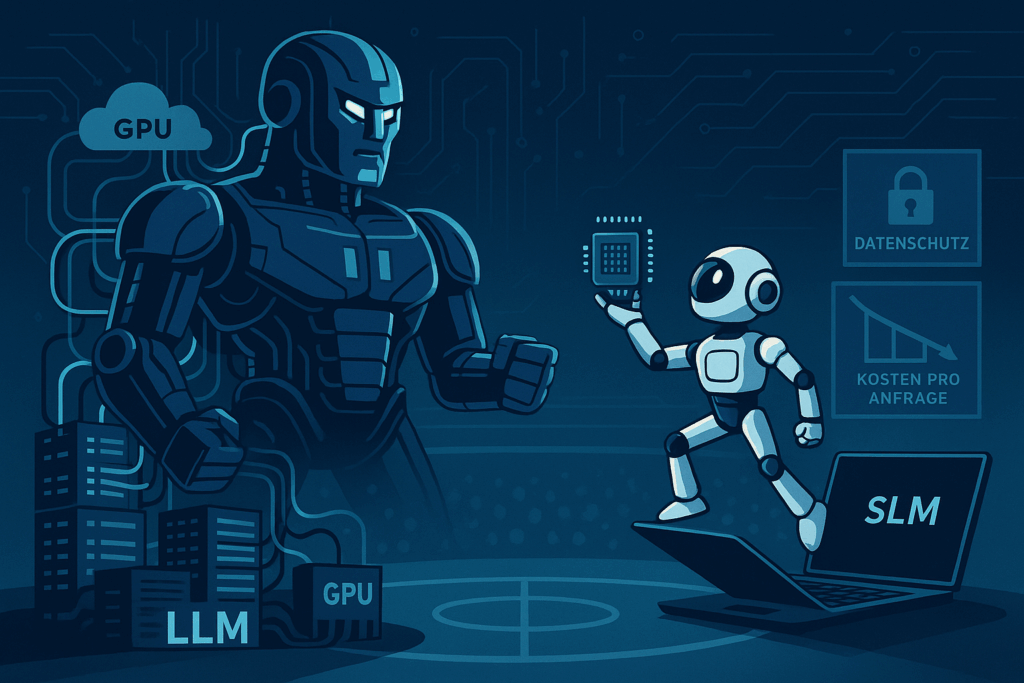

Generative KI hat die Art und Weise, wie wir arbeiten, grundlegend verändert. Doch während Large Language Models (LLMs) wie GPT-4 oder Gemini die Schlagzeilen dominieren, sehen sich Unternehmen, Freiberufler und Marketingteams mit einer neuen Realität konfrontiert: Hohe Kosten, mangelnder Datenschutz und massive Rechenanforderungen können den praktischen Einsatz schnell erschweren.

Lange Zeit galt die Devise „größer ist besser“. Doch die Entwicklung von Small Language Models (SLMs) signalisiert einen strategischen Paradigmenwechsel. SLMs sind keine bloßen „Lite-Versionen“, sondern eine bewusste Neuausrichtung hin zu spezialisierter, effizienter und datenschutzkonformer KI. Sie bieten eine pragmatische Antwort auf die Herausforderungen, die große Modelle mit sich bringen, und eröffnen völlig neue Einsatzmöglichkeiten, insbesondere dort, wo es auf Schnelligkeit, Kontrolle und Kosteneffizienz ankommt.

Dieser Artikel ist Ihr umfassender Leitfaden, der die Welt der SLMs beleuchtet und Ihnen hilft, die strategischen Entscheidungen für Ihre eigene KI-Roadmap zu treffen.

Podcast-Version zum reinhören:

Die strategischen Vorteile von SLMs für Unternehmen, Freiberufler und Marketer

Die Entscheidung für SLMs bringt eine Reihe klarer, strategischer Vorteile mit sich, die weit über rein technische Aspekte hinausgehen.

Kosten- und Energieeffizienz: KI wird skalierbar und nachhaltig

SLMs sind im Betrieb erheblich kostengünstiger. Die geringere Parameterzahl bedeutet weniger Rechenoperationen, was sowohl Training als auch Inferenz wesentlich sparsamer macht.

- Kostenvorteil: Der Betrieb eines SLM kann die Kosten im Vergleich zu einem LLM um bis zu 20 Mal senken. Unternehmen können KI-Funktionalität implementieren, ohne hohe Cloud-Budgets für GPU-Zeit einplanen zu müssen.

- Energieeffizienz: Weniger Rechenaufwand bedeutet auch weniger Energiebedarf. SLMs gelten daher als energieeffizientere KI-Lösungen mit einem geringeren CO2-Fußabdruck.

Geschwindigkeit und Latenz: Echtzeit-KI am Endpunkt (Edge Computing)

SLMs spielen ihren Vorteil bei der Geschwindigkeit voll aus. Kleinere Modelle antworten schneller, da weniger Berechnungen durchgeführt werden müssen.

- Niedrige Latenz: Bei On-Device-SLMs entfällt die Netzwerklatenz, da Anfragen lokal verarbeitet werden. Antwortzeiten im Millisekundenbereich sind erreichbar, selbst ohne Internetverbindung.

- Anwendungsbeispiele: Dies ist entscheidend für Echtzeit-Anwendungen wie Live-Übersetzung, Sprachassistenten oder autonome Fahrzeuge.

Datenschutz und Sicherheit: Private KI hinter der Firewall

Dies ist ein zentraler strategischer Vorteil. Da SLMs direkt auf Endgeräten oder in der unternehmenseigenen IT laufen können, bleiben sensible Daten lokal und müssen nicht zur Verarbeitung an externe Cloud-Dienste gesendet werden.

- Compliance: Dieser „Privacy by Design“-Ansatz erleichtert die Einhaltung strenger Datenschutzgesetze wie der DSGVO oder HIPAA. Unternehmen in regulierten Branchen wie Finanzen oder Gesundheitswesen können KI-Funktionalität nutzen, ohne das Risiko von Datenschutzverletzungen einzugehen.

- Vertrauen: Die transparente Kommunikation, dass Daten lokal verarbeitet werden, schafft Vertrauen bei Nutzern und Kunden.

Die Demokratisierung der KI: Zugänglichkeit für alle

SLMs senken die Eintrittsbarrieren für die Entwicklung und den Einsatz von KI erheblich.

- Kostensenkung: Kleinere Firmen, Start-ups oder Einzelpersonen können sich das Training eines SLM leisten, während ein LLM-Training unerschwinglich wäre. Dies fördert Innovation und verhindert, dass KI-Fähigkeiten nur in den Händen einiger weniger Tech-Giganten liegen.

- Endnutzer-Kontrolle: Mit SLMs können Communities eigene Modelle trainieren, die auf ihre spezifischen Bedürfnisse zugeschnitten sind. Dies ermöglicht eine inklusivere und vielfältigere KI-Entwicklung, die auch unterrepräsentierte Sprachen und Dialekte berücksichtigt.

Anwendungsfälle in der Praxis: Wann ist ein SLM die bessere Wahl?

Die Überlegenheit eines Modells ist nicht absolut, sondern hängt stark vom spezifischen Anwendungsfall ab. SLMs entfalten ihr Potenzial besonders in Szenarien, in denen leichte, lokale KI-Intelligenz gefragt ist.

Mobile Geräte und Edge-Computing

- Autovervollständigung und Texterkennung: Viele Keyboard-Apps nutzen kleine Sprachmodelle, die offline und direkt auf dem Smartphone laufen.

- Offline-Sprachassistenten: Sprachbefehle können lokal verarbeitet werden, was die Abhängigkeit von der Cloud reduziert.

- Augmented Reality (AR): SLMs können auf AR-Brillen laufen, um Texte in der Umgebung zu erkennen und zu übersetzen, ohne Cloud-Verbindung.

Enterprise-Lösungen mit höchsten Datenschutzanforderungen

Unternehmen, die auf sensiblen Daten sitzen, können interne KI-Assistenten bauen, die komplett on-premises laufen.

- Intranet-Chatbot: Ein auf firmeninterne Dokumente trainierter SLM beantwortet Mitarbeiterfragen, ohne dass vertrauliche Informationen nach außen dringen.

- Vertragsanalyse: Kanzleien können ein SLM auf Tausende von Verträgen und Urteilen trainieren, um Klauseln zu prüfen oder Zusammenfassungen zu erstellen – alles innerhalb der Organisation.

Branchenspezifische Anwendungsbeispiele

- FinTech: Ein SLM kann auf regulatorische Dokumente und rechtliche Texte trainiert werden, um Compliance-Prüfungen zu automatisieren. Ein großes Finanzinstitut konnte so die Dokumentenverarbeitung um das 2,5-fache beschleunigen und die Kosten um 80 % senken. SLMs werden auch für die Erkennung von Betrugsmustern (Fraud Detection) eingesetzt, um sensible Daten nicht in die Cloud zu senden.

- MedTech: Im Gesundheitswesen ist der Datenschutz von Patientendaten von größter Bedeutung. SLMs können in Wearables oder medizinischen Geräten am Körper des Patienten Sensordaten lokal verarbeiten, um in Echtzeit Anomalien zu erkennen und Warnungen auszugeben.

- Automotive: Im Fahrzeug können SLMs als In-Car-Assistenten dienen, die Sprachbefehle und Echtzeit-Sensordaten analysieren. Dadurch werden Funktionen wie die vorausschauende Wartung ermöglicht, bei der Anomalien im Fahrverhalten erkannt werden, die auf einen baldigen Defekt hinweisen.

- Industrie 4.0: In der Fertigung können SLMs auf IoT-Geräten Predictive Maintenance-Aufgaben ausführen, indem sie Maschinendaten lokal analysieren und Wartungsbedarf vorhersagen.

Die Koexistenz von SLM und LLM: Hybridansätze als Königsweg

In den meisten komplexen Unternehmensszenarien ist ein reines Entweder-Oder-Szenario zu kurz gedacht. Der Königsweg liegt oft in einer intelligenten Kombination, einem sogenannten Hybridansatz, der die Stärken beider Modelle synergetisch nutzt.

SLM als „Vorarbeiter“, LLM als „Experte“: Smarte Arbeitsteilung

Ein klassisches Hybridmodell sieht eine Arbeitsteilung vor:

- SLM als Vorverarbeitung: Ein SLM übernimmt die Vorverarbeitung von Anfragen. Beispielsweise könnte ein Support-Chatbot 80 % der Standardfragen direkt und schnell beantworten, wodurch die hohen Kosten für ein LLM vermieden werden.

- LLM als Nachverarbeitung oder bei komplexen Fällen: Nur wenn eine Anfrage komplex ist oder über das Fachgebiet des SLMs hinausgeht, wird sie an ein LLM weitergeleitet.

- Orchestrierung: Ein LLM kann auch als „Dirigent“ fungieren, der eine komplexe Anfrage grob analysiert und dann passende SLMs ansteuert, um spezifische Informationen zu extrahieren, bevor das LLM die finale Antwort formuliert.

Retrieval-Augmented Generation (RAG) mit SLMs

Ein RAG-System ergänzt ein Sprachmodell mit externen Wissensquellen. SLMs spielen hierbei eine wichtige Rolle. Ein kleines Modell kann die Nutzeranfrage in einen Embedding-Vektor umwandeln, um passende Dokumente aus einer lokalen Wissensdatenbank zu finden. Die so angereicherten Informationen können dann entweder von einem größeren Modell oder sogar einem anderen SLM zur Generierung der Antwort genutzt werden. Dieser Ansatz kompensiert die Limitierung der SLM-Parameter durch externes, aktuelles Wissen.

Herausforderungen und Limitationen von SLMs

Trotz der vielen Vorteile gibt es auch Herausforderungen, denen sich Unternehmen bei der Nutzung von SLMs stellen müssen.

Begrenzte Kapazität und Verallgemeinerungsfähigkeit

Aufgrund ihrer geringeren Parameterzahl und spezialisierten Trainingsdatensätze ist die Fähigkeit von SLMs, komplexe oder vielseitige Sprache zu verstehen, eingeschränkt. Sie sind Experten mit Tunnelblick und können bei Anfragen außerhalb ihres Spezialgebiets an ihre Grenzen stoßen. SLMs sind auch bei komplexen Aufgaben, die ausgeprägtes logisches Denken erfordern, weniger präzise als LLMs.

Ethische Risiken: Von „Small-Data-Bias“ bis Missbrauch

Die Dezentralisierung und Demokratisierung der KI birgt auch neue ethische Herausforderungen.

- Small-Data-Bias: Da SLMs auf kleineren, oft sorgfältig kuratierten Datensätzen trainiert werden, besteht die Gefahr, dass einseitige Trainingsdaten unmittelbarer durchschlagen. Der Bias des Kurators oder der Datenquelle kann unbeabsichtigt in das Modell einschleusen, was zu einer mangelnden Repräsentativität führt.

- Mangelnde zentrale Überwachung: Bei einem SLM, das lokal auf einem Rechner läuft, gibt es keine zentrale Überwachung durch den Entwickler. Dies kann die Verbreitung von schädlichen oder böswillig modifizierten Modellen erleichtern und das Risiko des Missbrauchs erhöhen.

Die Marktlandschaft: Wer treibt den Wandel voran?

Der Trend zu SLMs spiegelt sich auch in der Strategie großer Tech-Unternehmen wider.

- Microsoft ist ein Vorreiter mit seiner Phi-Serie, die als die „leistungsfähigsten und kostengünstigsten SLMs“ angekündigt wurde. Microsoft verfolgt eine Doppelstrategie, indem es LLMs und SLMs als komplementäre Portfolio-Angebote positioniert.

- Meta (Facebook) hat mit seinen LLAMA-Modellen eine offene Strategie gewählt, die die Open-Source-Community zur Entwicklung zahlreicher SLM-Derivate inspiriert hat.

- Google hat seine PaLM-Modelle bewusst in vier verschiedenen Größen veröffentlicht, um KI-Funktionalität auch auf Mobilgeräten offline nutzbar zu machen.

- Start-ups wie Upstage oder Geniusee haben sich auf maßgeschneiderte SLM-Lösungen für den On-Premise-Einsatz spezialisiert.

Diese Entwicklung verschiebt den Wettbewerb: Der Vorteil liegt nicht mehr nur im Besitz des größten Modells, sondern in der Expertise, Modelle zu fine-tunen, zu optimieren und effizient in komplexe Agenten-Pipelines zu integrieren.

Entscheidungsmatrix: So wählen Sie das passende Modell für Ihr Projekt

Die Wahl zwischen SLM und LLM ist eine strategische Entscheidung. Folgende Kriterien sollten Sie als Unternehmer oder Manager abwägen:

- Aufgabenkomplexität: Ist die Aufgabe eng und repetitiv (z.B. Datenextraktion)? → SLM. Erfordert sie breites Allgemeinwissen und Kreativität? → LLM.

- Latenz und Echtzeitbedarf: Muss die Antwort sofort verfügbar sein, auch offline? → SLM. Ist eine geringe Latenz tolerierbar? → LLM.

- Datenschutz: Müssen sensible, proprietäre Daten lokal verbleiben? → SLM. Sind die Daten öffentlich oder kann eine externe Verarbeitung toleriert werden? → LLM.

- Kosten und Skalierung: Erwarten Sie viele Nutzer und hohe Skalierung? → SLM. Sind die laufenden Kosten weniger kritisch? → LLM.

- Entwicklungshorizont & Team-Expertise: Hat Ihr Team das Know-how, ein Modell zu trainieren und zu warten? → SLM. Bevorzugen Sie eine schnelle „Plug-and-Play“-Lösung? → LLM.

Fazit: Small is beautiful – Die Zukunft der KI ist dezentral

Small Language Models sind nicht einfach nur eine Übergangsphase, sondern eine grundlegende Neuausrichtung in der Welt der KI. Sie bieten eine überzeugende Antwort auf die Herausforderungen von Kosten, Latenz und Datenschutz, die der großflächige Einsatz von LLMs mit sich bringt. Durch ihre Effizienz und Spezialisierung ermöglichen sie es, KI „in die Fläche“ zu bringen – in Geräte, Unternehmen und Anwendungsfälle, die bisher außen vor blieben.

Die Zukunft wird nicht von einem einzigen Modell-Typ dominiert, sondern von einer intelligenten Koexistenz. LLMs bleiben die unschlagbaren Experten für komplexe, kreative Aufgaben, während SLMs die Rolle der effizienten, spezialisierten Arbeitsbiene übernehmen. Die strategische Entscheidung ist nicht mehr ein Entweder-Oder, sondern die kluge Orchestrierung beider Modelltypen, um das volle Potenzial der generativen KI zu nutzen – schnell, sicher und kosteneffizient.

FAQ – Häufig gestellte Fragen zu Small Language Models

- Was ist der größte Unterschied zwischen SLM und LLM?

- Der größte Unterschied liegt in der Modellgröße (Parameteranzahl) und dem Einsatzzweck. LLMs wie GPT-4 haben über eine Billion Parameter und sind Alleskönner mit breitem Allgemeinwissen. SLMs haben weniger als 10 Milliarden Parameter und sind auf spezialisierte, domänenspezifische Aufgaben zugeschnitten.

- Sind SLMs weniger intelligent als LLMs?

- SLMs sind nicht unbedingt weniger intelligent, sondern ihre Kompetenz ist fokussiert. In ihrem eng umrissenen Fachgebiet können sie oft präzisere und relevantere Ergebnisse liefern als ein LLM. Allerdings fehlt ihnen die Generalisierungsfähigkeit und das breite Weltwissen großer Modelle.

- Für welche Aufgaben sollte ich ein SLM einsetzen?

- SLMs eignen sich ideal für repetitive, spezialisierte Aufgaben, bei denen Kosten, Geschwindigkeit und Datenschutz kritisch sind. Beispiele sind interne Chatbots für Mitarbeiterfragen, E-Mail-Klassifizierung, Datenextraktion aus Dokumenten oder On-Device-Anwendungen auf Smartphones oder IoT-Geräten.

- Sind SLMs immer die bessere Wahl?

- Nein, SLMs sind nicht für alle Aufgaben geeignet. Für komplexe, offene Aufgaben, die tiefes logisches Denken, breites Weltwissen oder kreative Textgenerierung erfordern (z.B. das Schreiben eines Buches oder die Beantwortung von mehrdeutigen Fragen), sind LLMs oft die überlegene Wahl.

- Welche Rolle spielen Hybridmodelle?

- Hybridmodelle nutzen die Stärken beider Modelltypen. Ein SLM kann eine Anfrage vorverarbeiten (z.B. eine Anfrage klassifizieren), während ein LLM für die abschließende, komplexe Antwortgeneration genutzt wird. Dies ermöglicht die Effizienz und Geschwindigkeit von SLMs mit der Flexibilität und dem Wissen von LLMs zu kombinieren.